Déjouer les machines : Présentation du projet Faceshield, interview

De quoi parle-t-on lorsque l’on évoque la reconnaissance faciale comme un risque ?

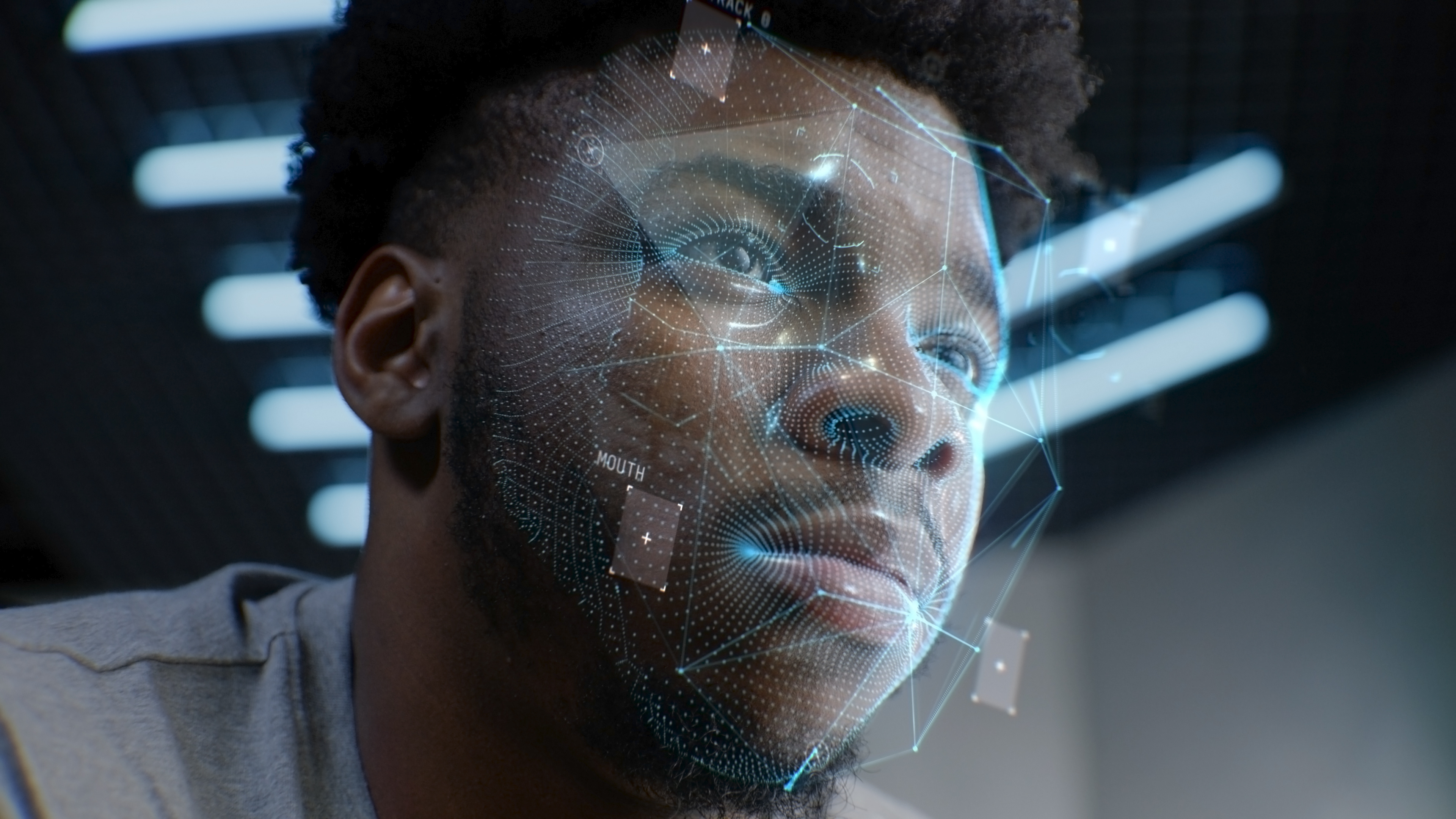

Les photos que nous prenons avec nos smartphones sont souvent, quasi exclusivement, stockées dans des Clouds appartenant à Apple, Microsoft ou autres acteurs des GAFAM. Aujourd’hui, ces images peuvent être analysées par des machines capables d'identifier des individus, de créer des profils et d'extraire d'innombrables informations à des fins publicitaires. Ce qui nous inquiète, c'est que, même si ces images sont stockées de manière sécurisée, il n’existe aucune garantie contre un usage malveillant. Par exemple, des applications de reconnaissance faciale pourraient être utilisées pour surveiller ou contrôler des personnes, un scénario qui devient d'autant plus préoccupant dans des contextes moins démocratiques.

Les grandes entreprises comme Google ont-elles accès à nos photos sans que nous le sachions ?

Absolument. Lorsque nous parlons de sécurité, il est essentiel de comprendre que cela ne concerne pas seulement les menaces externes. Les opérateurs des services de l'OS (Google pour Android, ou Apple pour iPhone) peuvent avoir directement accès aux traces GPS du téléphone; et dans certaines configurations, la position GPS est directement encodée dans chaque photo prise par le téléphone. Face à cette menace, l'identification du lieu par l'IA peut sembler anecdotique. Ce qui est moins anecdotique, c'est l'identification automatique du niveau de vie, de l'orientation politique ou sexuelle, et des hobbies ou tout autre élément utile pour la publicité ciblée.

Que proposez-vous pour empêcher les machines de nous identifier à partir de nos photos ?

Notre objectif est de transformer les photos de manière à ce qu'elles ne soient plus utilisables pour la reconnaissance faciale par des machines, tout en restant « indexables ». Cela signifie qu'un modèle pourra toujours comprendre le contenu de la photo, comme des images d'anniversaire ou de repas, sans pouvoir identifier les personnes qui y figurent. Nous avons développé un modèle utilisant des techniques d'attaque adversarielle, qui modifie subtilement les visages de façon à ce que cela soit à peine perceptible pour un humain, mais suffisamment pour désorienter les systèmes de reconnaissance des machines.

Quelles expertises de la HEIG-VD ont été utiles dans ce projet ?

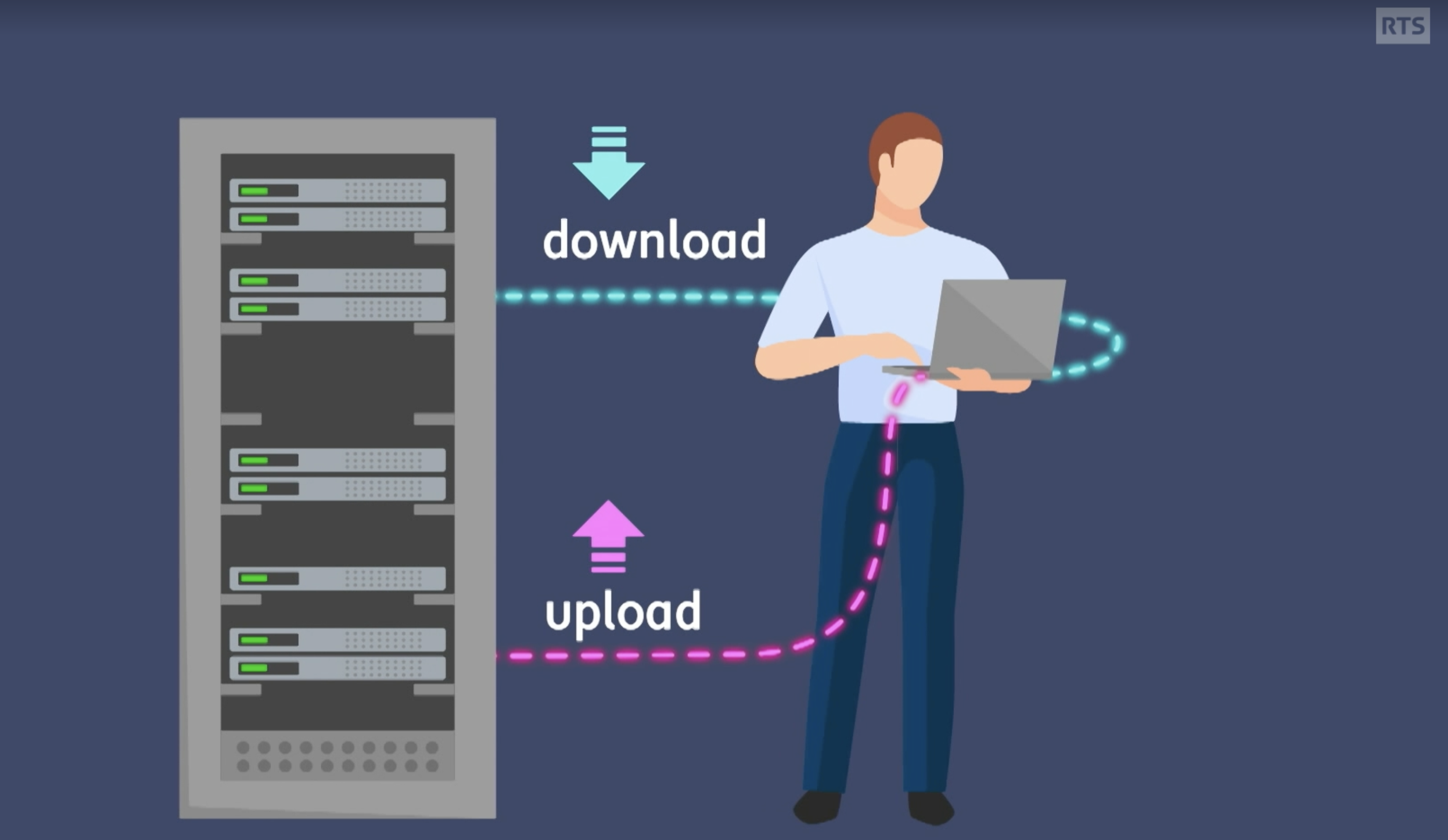

Nous nous concentrons sur la sécurisation des photos altérées. Lorsque nous transformons une image, nous y intégrons des données chiffrées. Cela signifie que le fournisseur de stockage ne peut voir que la version modifiée, sans accès à la photo originale. Cependant, si vous possédez la clé secrète, vous pouvez récupérer l’image authentique. Cela permet aussi de partager des photos avec des amis ou de la famille tout en maintenant la sécurité.

Votre projet permet donc de sécuriser le partage de nos données et photos tout en empêchant leur lecture par des machines ?

Exactement. Nous tenons à garantir la souveraineté des utilisateurs sur leurs données. Nous avons conçu un système de partage qui limite les conséquences en cas de piratage. Même en cas de compromission, le pire scénario serait que des personnes perdent temporairement l'accès aux photos, mais elles pourraient toujours partager à nouveau via un autre service. Nous utilisons des techniques de cryptographie aux constructions classiques éprouvées pour assurer cette sécurité.

Quelles sont les grandes difficultés avez-vous rencontrées à ce stade ?

Un des plus grands défis est de minimiser la collecte de données personnelles. Nous ne voulons pas savoir qui utilise notre service ou partager des informations sur les relations entre utilisateurs. Tout le contenu reste sur le client, et même en cas de compromission, les photos doivent rester inaccessibles. Cela complique le système, car il doit fonctionner efficacement tout en respectant la vie privée des utilisateurs.

Est-ce que le projet est déjà terminé et peut-on utiliser l’outil ?

Le projet a démarré cet été et devrait se terminer mi-2026. Il est financé par le consortium SEAL. À la fin, nous voulons créer un prototype fonctionnel. Une startup, RayShaper, s'occupera de sa mise en œuvre. L’idée est de développer un service web et un plugin qui protégeront automatiquement les photos téléchargées. Cela nécessitera que la protection soit appliquée dès le départ pour être réellement efficace.